Pornografia com inteligência artificial expõe adolescentes e ameaça comunidade escolar

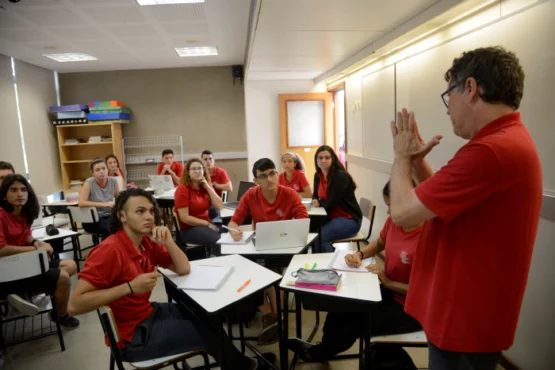

Foto: Marcello Casal Jr/Agência Brasil

Foto: Marcello Casal Jr/Agência Brasil

Imagens e vídeos feitos com uso de programas de edição que possuem ou se utilizam de algoritmos de Inteligência Artificial (IA) não estão só disponíveis facilmente para incrementar trabalhos e até para a diversão pessoal dos estudantes aficionados em tecnologia.

É o que mostra a escalada de pornografia que utiliza deepfakes (falsificações feitas por IA) que tem assustado pais, professores e estudantes brasil afora, como no recente caso de um tradicional colégio de Porto Alegre que, de uma hora para outra, teve pelo menos 16 de suas alunas expostas como se estivessem nuas em montagens feitas por colegas de classe.

Mais do que virar um caso de polícia, como em situações anteriores ocorridas em outras cidades, a questão posta é como lidar com o assunto em uma época em que a legislação não consegue acompanhar o ritmo ditado pelo progresso acelerado do mundo dos algoritmos.

Vale lembrar que, quando essas práticas criminosas envolvem menores de idade, os casos são enquadrados como atos infracionais, respeitando o Estatuto do Menor e do Adolescente (ECA).

Para André Lucas Fernandes, diretor do Instituto de Pesquisa em Direito e Tecnologia do Recife, capital que viu 40 alunas de outra tradicional escola expostas em situação semelhante em novembro de 2023, “soluções que apelam para moralismo, banimento, prisão, somente esse tipo de coisa, não são muito produtivas”.

Fora de controle

Advogado e professor na Especialização de Direito Digital na Cesar School, Fernandes, que também integra a Coalizão Direitos na Rede, tampouco vê possibilidades de um controle técnico e até desaconselha.

“A gente tem até medo disso porque sabemos que existem fins legítimos para usar esse tipo de tecnologia”, afirma.

Fernandes ao lembrar que a tecnologia do deepfake não é uma novidade, pois tem sido usada há anos na indústria do cinema e em outras artes, aparece agora como um forte problema quando má utilizada, devido ao que chama de “escalabilidade”, o fácil acesso e uso em larga escala.

“Nesse sentido, infelizmente, tal qual acontece com a desinformação em geral, a divulgação de imagens falsas, a gente não tem muito como controlar; a não ser em uma solução mais geral de banimento desse modelo de negócio, enfim, uma ação muito radical que não é o que a gente trabalha agora”, pondera.

Na moda, mas sem pedagogia

Apesar da IA estar “na moda”, o diretor do IP.rec afirma não ter visto ainda nada de concreto em termos educacionais para mostrar que, no caso específico das chamadas deepfakes pornográficas que têm surgido nos ambientes escolares, “há implicações criminais”, considera.

“Então, isso precisa ser colocado também, de forma muito clara, pela comunidade escolar, a partir de uma diretriz pedagógica. É necessário que se explique o que é IA, que ela está disponível no nosso dia-a-dia; que a gente a tem nos bancos; como atendente para marcar exames, médico, enfim, uma série de serviços privados e públicos, que são intermediados por ela e que ela também pode ser usada pelos estudantes, mas com responsabilidade”, enfatiza.

Concretamente, Fernandes entende que a comunidade escolar como um todo, estudantes, professores, funcionários, pais e mães, devem ser chamados para conversar sobre IA “de forma honesta, de forma clara, sem subestimar também crianças e adolescentes que já tem conhecimento para usar a tecnologia”.

Isso não descarta punições no âmbito administrativo escolar, lembra ele.

“Se isso (deepfake) foi feito usando imagens de colegas, se cabe uma punição educativa, então, deve ser feito”, assevera.

Mulheres como alvo

A criação de deepfakes vem crescendo de forma exponencial no mundo. Só em 2023 foram encontrados 95.820 vídeos, um aumento de 550% em relação a 2019.

Apesar de boa parte do enfoque da mídia se concentrar nos potenciais riscos político eleitorais, dados têm revelado outra realidade aterradora.

Conforme um estudo da consultoria americana de segurança Home Security Heroes, 98% dos vídeos deepfakes identificados em 2023 são pornográficos. Entre esses, 99% têm como vítimas mulheres. No mundo da escola não é diferente.

De acordo com análises do IP.rec, parte considerável dos casos de deepfakes pornográficas no Brasil ocorrem no ambiente escolar e como são geradas por menores de idade escapam do escopo de importantes Projetos de Leis que tramitam no Congresso Nacional.

É por isso que o instituto defende que discussões sobre IA sejam inseridas nas agendas educacionais.

Assim, segundo Fernandes, “orientando outras dimensões políticas que não a criminal, é possível resultar num efeito preventivo maior do que o efeito proativo-criminal”.