Como o Google sabe o que você quer?

Foto: Tracy Le Blanc/Pexels

Foto: Tracy Le Blanc/Pexels

É comum o relato de alguém que pesquisou algum produto no celular e, momentos depois, recebeu notícias e propagandas com promoções e outras informações deste item.

Isso ocorre por conta do “perfilamento”, uma coleta de três tipos de dados, que cria um “perfil” para cada usuário. Esse sistema otimiza o que será entregue para cada pessoa por meio de informações oferecidas pelo usuário, traços de uso coletados pela própria plataforma/aplicativo que está sendo utilizada e dados deduzidos pelos algoritmos.

NESTA REPORTAGEM

De acordo com a especialista em Interação Humano-computador e Organização do Conhecimento, Luciana Monteiro-Krebs, o indivíduo não paga mais para utilizar as redes sociais e outros serviços digitais, por isso os dados são a forma de pagamento. Ela também aponta que redes como Facebook e Instagram têm mais de uma centena de atributos para criar perfis de usuários.

“Aceitamos fazer esta troca sempre que pressionamos o botão ‘Aceito os Termos e Condições de Uso’. Termos que raramente lemos na íntegra”, explica a pesquisadora. Isso ocorre pois os anunciantes das plataformas querem interação com os seus conteúdos. Com essas informações fica mais claro saber qual conteúdo entregar para quem está utilizando o serviço.

Luciana exemplifica como essas informações são lidas e interferem no conteúdo que é entregue. “É com base nesse perfil que o sistema vai definir o quê o usuário vai ver no feed, em que ordem os conteúdos vão aparecer e a que momento. Por exemplo, às 22h, quando você está cansado na cama, é muito mais provável que você assista e curta vídeos satisfatórios, engraçados e rápidos do que um anúncio longo para um workshop relacionado a trabalho”, explica.

Os algoritmos

Desde a rota mais rápida no GPS, até o preço mais baixo para um determinado produto e interfaces personalizadas para cada pessoa, os algoritmos guardam dados de cada usuário para entregar melhores resultados na hora de uma pesquisa.

No entanto, apesar de trazer facilidades, os algoritmos também são agentes de segregação e limitadores da experiência dentro do mundo virtual.

O pesquisador em Políticas de Tecnologia da Fundação Mozilla, Tarcizio Silva, explica que essa ideia de inteligência artificial que recomenda conteúdos se popularizou por conta de plataformas como o Facebook.

“Mas eles (os algoritmos) não são neutros ou independentes. Sistemas algorítmicos reúnem dezenas a centenas de algoritmos construídos sob objetivos de negócio específicos e, alguns deles, podem ocultar decisões políticas e ideológicas intencionais. Por isso, quando possuem grande impacto, deveriam idealmente ser monitorados e regulados pela sociedade civil”, afirma

Para Tarcizio, a ideia de não pagar pelo uso dos aplicativos esbarra no momento que as plataformas utilizam do serviço dos usuário para conseguir o lucro.

“As plataformas só conseguem o sucesso comercial alcançado graças à extração de bilhões de horas de trabalho gratuito das pessoas que as usam, produzindo conteúdo, entretenimento e, efetivamente, todos os atrativos que as tornam negócios lucrativos”, explica.

Controlados por empresas e organizações, essa ferramenta tem como objetivo principal o êxito nos negócios e na política.

“Quando falamos de mídias sociais, os sistemas algorítmicos de recomendação de conteúdo, moderação de discurso de ódio, exibição de anúncios ou organização de timelines são construídos para gerar o máximo de métricas de negócio publicitário”, informa Tarcizio.

Como priorizam o lucro, as empresas que desenvolvem e modulam os sistemas algorítmicos costumam deixar de lado “direitos humanos, bem-estar social, emprego e soberania nacional em segundo plano”, de acordo com o pesquisador.

Racismo algorítmico

“Ensinados” por meio das preferências dos usuários, os algoritmos tendem a repetir padrões que ocorrem na sociedade, como o racismo, machismo e discriminação de gênero, por exemplo.

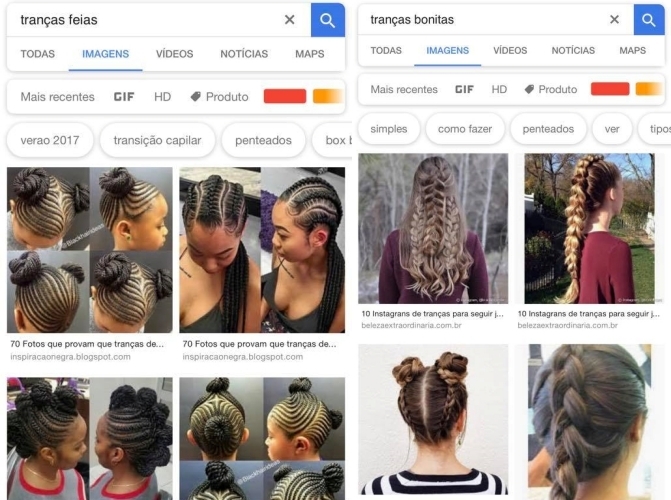

Em 2019 o caso das “tranças feias” e “tranças bonitas” foi denunciado e virou notícia no país. Ao pesquisar no Google esses termos o usuário teria dois resultados diferentes.

Para o primeiro termo, apareciam mulheres negras com o cabelo trançado, reforçando uma ideia racista de que o cabelo crespo e os penteados em mulheres negras seriam feios.

O segundo resultado, para “tranças bonitas”, mostrava mulheres brancas, com cabelos lisos e, na sua grande maioria, claros ou iluminados.

Foto: Reprodução/Internet

De acordo com Tarcizio Silva, o racismo algorítmico também está presente em inteligências artificiais e gera discriminação nas redes digitais

Foto: Reprodução/Internet

Chamado de “racismo algorítmico”, esse exemplo mostra como os algoritmos também são uma ferramenta que precisa de atenção. Ao aprender por meio do comportamento humano, ele repete, inclusive, os mesmos crimes que ocorrem em sociedade.

Em seu site, Tarcizio lembra que essa questão vai além das pesquisas na internet.

“Há casos mapeados em áreas claramente muito graves, como decisões judiciais automatizadas ou reconhecimento facial que podem gerar, por exemplo, a prisão injusta de uma pessoa inocente. Isto mostra a necessidade, já avançada em alguns países, de permitir a ‘auditoria algorítmica’ para que sistemas contratados por governos sejam justos e não possam ser usados para fins nocivos”, afirma Tarcizio.

A nota publicada pela Google na época reforça a fala de Tarcizio e a visão de que os algoritmos precisam de fiscalização.

“Construir uma experiência de busca é um desafio complexo, dinâmico e em constante evolução. Como nossos sistemas encontram e organizam informações disponíveis na web, eventualmente, a busca pode espelhar estereótipos existentes na internet e no mundo real em função da maneira como alguns autores criam e rotulam seu conteúdo. Entendemos que pessoas de todas as raças, gêneros e grupos podem ser afetadas por essas representações. Compartilhamos essa preocupação e continuaremos trabalhando para melhorar os resultados de busca de imagens para todos nossos usuários”, publicou a empresa.

Questões de gênero

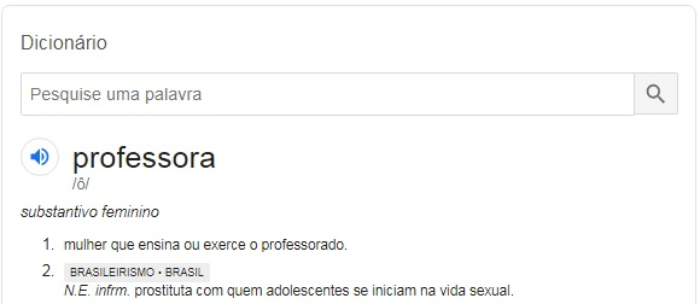

Além das questões raciais, o buscador do Google também já foi acusado de reproduzir comportamentos machistas. Também em 2019, ao buscar o significado dos termos “professor” e “professora” o usuário recebia um resultado ofensivo para o termo relacionado às profissionais da educação.

Foto: Reprodução

Resultado de pesquisa rebaixava as professoras e sugeria que estas profissionais iniciavam os adolescentes na vida sexual

Foto: Reprodução

A polêmica resultou em uma ação judicial proposta por estudantes de direito da Pontifícia Universidade Católica de Goiás e uma nota oficial da Google sobre o caso. Na ocasião a empresa afirmou que trabalha com conteúdos licenciados de dicionários parceiros e que a definição já havia sido removida.

Para evitar casos como esse, Tarcizio é enfático e diz que é fundamental “o controle social da tecnologia”. Para o pesquisador, um futuro democrático e benéfico para o mundo também depende disso.

“O Brasil é um exemplo teórico sobre governança da internet multissetorial, com mecanismos de participação de setores como governo, empresas, sociedade civil e academia na discussão sobre políticas, regulação e caminhos da internet”, afirma.

No entanto, essa busca ainda é problemática e bate de frente com o setor privado que age, em alguns momentos, até promovendo desinformação sobre governança da internet, segundo Tarcizio.

Douglas Glier Schütz é estagiário de jornalismo. Matéria elaborada com supervisão de Valéria Ochôa, editora-chefe.